suivant: Avancée des méthodes de monter: Introduction précédent: Résultats expérimentaux Table des matières

Pour comprendre le type d'étude qui va être mené ici, nous allons montrer

que nous disposons aujourd'hui des capacités de calcul suffisantes pour

permettre de modéliser des mécanismes qui ne nous étaient pas accessibles

il y a encore quelques années.

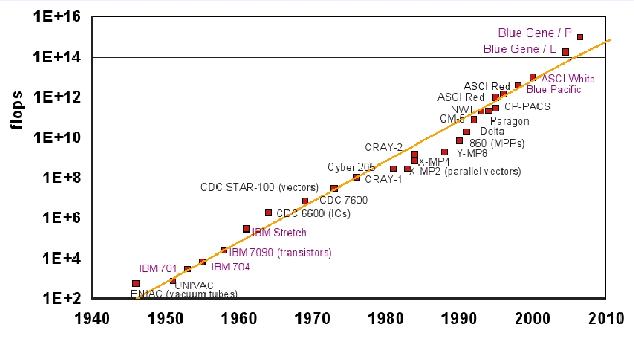

En effet, une loi empirique, la loi de Moore,

suppose que le nombre de composants par unité de surface, et donc la puissance de calcul,

double tous les un an et demi (Fig 1.3).

De même, les composants périphériques, comme la

mémoire vive et l'espace de stockage, augmentent aussi leurs capacités

pour suivre l'accroissement énorme du nombre d'instructions traitées par unité de temps.

Cette loi empirique de Moore, se vérifie depuis le déclin des calculateurs mécaniques.

Le premier ordinateur électrique est créé en 1946

grâce à J. Mauchly, J. Presper

Eckert et surtout Joannes Von Neuman : l'ENIAC (Electronic Numerical Integrator And

Computer). Il était composé de 18.000 lampes à vide et occupait une place de 1500 ![]() .

Ce calculateur était surtout limité par sa programmation et le suivi de ses instructions

qui s'effectuaient manuellement.

Il est donc considéré aussi, comme le dernier ordinateur mécanique.

Les générations suivantes d'ordinateurs

ont rapidement fait apparaître les langages de programmation, en particulier le

FORTRAN, qui est l'un des premiers langages de programmation scientifique.

Ceci explique sûrement l'expansion des codes écrits dans ce langage par

soucis de recyclage de codes, bien que d'autres langages qui ont été inventés depuis sont

beaucoup plus performants.

Quelques années après sa création, l'ENIAC servit notamment à mettre au point la bombe à

hydrogène. Plus tard une multitude de progrès ont vu

le jour. Ces progrès sont probablement apparus avec l'accroissement des

moyens de calcul. Une autre étape importante, en plus des étapes technologiques,

a été la commercialisation des ordinateurs au grand public. Cette ouverture

de marché a rendu la recherche en électronique attractive pour les capitaux

privés, ce qui a provoqué une baisse du prix des composants et donc la possibilité

d'avoir des machines encore plus puissantes pour la recherche. Actuellement, les

machines les plus puissantes du monde sont fabriquées par les concepteurs de

machines grand public ( IBM, NEC ...) et non plus par des financements gouvernementaux.

.

Ce calculateur était surtout limité par sa programmation et le suivi de ses instructions

qui s'effectuaient manuellement.

Il est donc considéré aussi, comme le dernier ordinateur mécanique.

Les générations suivantes d'ordinateurs

ont rapidement fait apparaître les langages de programmation, en particulier le

FORTRAN, qui est l'un des premiers langages de programmation scientifique.

Ceci explique sûrement l'expansion des codes écrits dans ce langage par

soucis de recyclage de codes, bien que d'autres langages qui ont été inventés depuis sont

beaucoup plus performants.

Quelques années après sa création, l'ENIAC servit notamment à mettre au point la bombe à

hydrogène. Plus tard une multitude de progrès ont vu

le jour. Ces progrès sont probablement apparus avec l'accroissement des

moyens de calcul. Une autre étape importante, en plus des étapes technologiques,

a été la commercialisation des ordinateurs au grand public. Cette ouverture

de marché a rendu la recherche en électronique attractive pour les capitaux

privés, ce qui a provoqué une baisse du prix des composants et donc la possibilité

d'avoir des machines encore plus puissantes pour la recherche. Actuellement, les

machines les plus puissantes du monde sont fabriquées par les concepteurs de

machines grand public ( IBM, NEC ...) et non plus par des financements gouvernementaux.

Ainsi, la loi de Moore devrait continuer de se vérifier, compte tenu des technologies actuelles pendant encore une quinzaine d'années. Par contre, passé cet horizon, la taille des transistors diminuant sans cesse, nous allons nous heurter à une limitation physique. En effet, il n'est pas possible de réaliser un transistor de moins d'une cinquantaine d'atomes. La seule façon de continuer d'accroître la puissance de calcul sera donc d'augmenter à nouveau la taille des ordinateurs ou de changer la technologie sur laquelle ils sont basés.

|

|

Une des voies qui semble prometteuse, pour changer le type de technologie des ordinateurs, consiste à créer des transistors constitués de nanocristaux de tailles identiques. Les effets quantiques mis en jeu dans ce type de transistors permettent de quantifier la tension de seuil de ceux-ci. La logique binaire utilisée jusqu'alors peut par conséquent être remplacée par une logique multi-niveaux. Cette technologie ne pourra être réalisée, comme nous l'avons dit précédemment, qu'en contrôlant parfaitement la réalisation de nanocristaux. Dans ce cadre, la réalisation de nanocristaux bien caractérisés pourrait se faire par voie plasma, une technologie industrielle déjà bien établie, et dans ce cas notre étude prend tout son sens. Par nos études de modélisation, nous montrerons donc comment nous avons utilisé la technologie pour améliorer notre connaissance d'objets nanométriques potentiellement utiles à la technologie elle-même.